1. ラズパイとIntel Speech Enabling開発キットのセットアップ

まずはラズパイの設定から開始します。Raspberry Pi 3ボードに搭載されているもの -

- 4 USBポート

- ビデオ出力用のHDMIポート (HDMIモニターに接続するために利用します。)

- 音声出力のための3.5mmオーディオジャック (本ラボでは利用しません。IntelのDSPに接続します。)

- Micro SDカードスロット

- イーサネットポート

ラズパイの組み立て

- Micro SDカードをラズパイのMicro SDカードスロット差し込む (接触部分を上に向けるよう注意してください。)

- キーボードとマウスをUSBポートに接続

- HDMIポートを利用し、モニターに接続

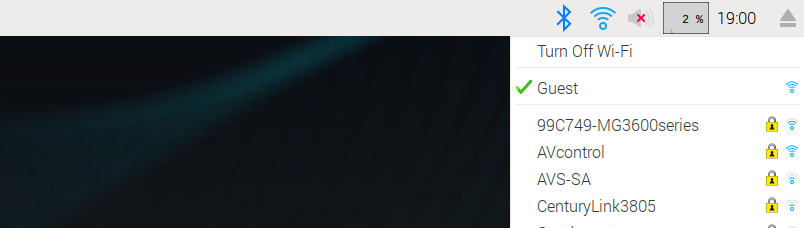

- イーサネットがある場合はケーブルを接続 - ない場合は、画面右上部にあるWifiのアイコンをクリックし、Wifiを有効にするとともに、SSIDを指定

Intel Speech Enabling開発キットの組み立て

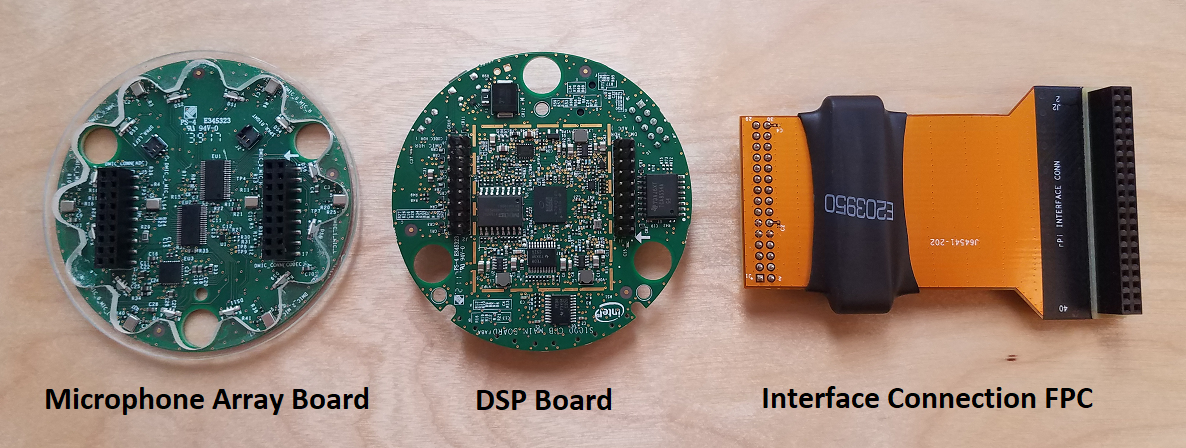

Intelのキットは音声をキャプチャするマイクロフォンアレイボード、オーディオの処理アルゴリズムを実装しているDigital Signal Processor (DSP) ボード、DSPボードとRaspberry Piを接続ためのInterconnect FPCが含まれています。組み立てる前にそれぞれが揃っていることを確認してください。

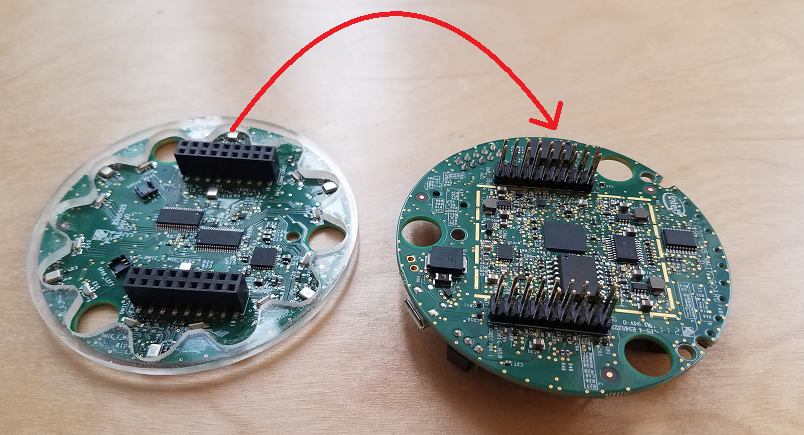

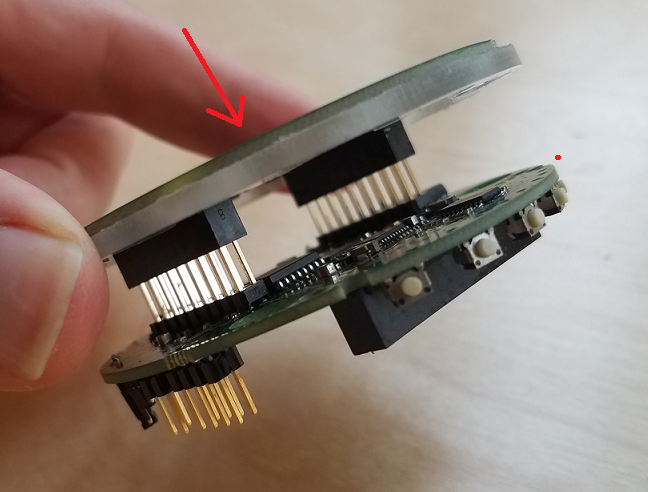

まず、マイクアレイボードとDSPボードの接続から行います。マイクアレイボードとDSPボードそれぞれに対となる2つのコネクターと端子があります。それらを慎重に差し込んでください。2つの円形ボードがずれることなく接続されていることを確認してください。

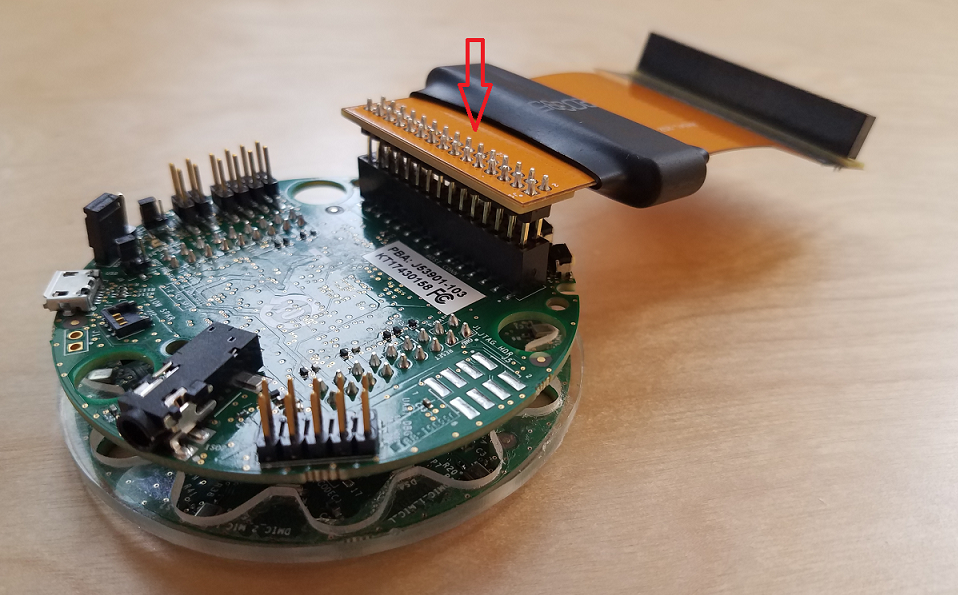

次にFPCをDSPボードに接続してください。DSPボードを裏返し、FPCの2つのコネクターのうち小さい方をボードに接続してください。FPCとDSPボードのピンがずれていないことを確認してからコネクターをしっかりと差し込んでください。

それではFCPのもう一方(大きいコネクター側)をRaspberry Piに接続します。DSPボードをひっくり返すことで、FPCのコネクターが下側になるため組み立て安くなります。Raspberry Piのピン配列に合わせ、慎重にコネクターを接続してください。

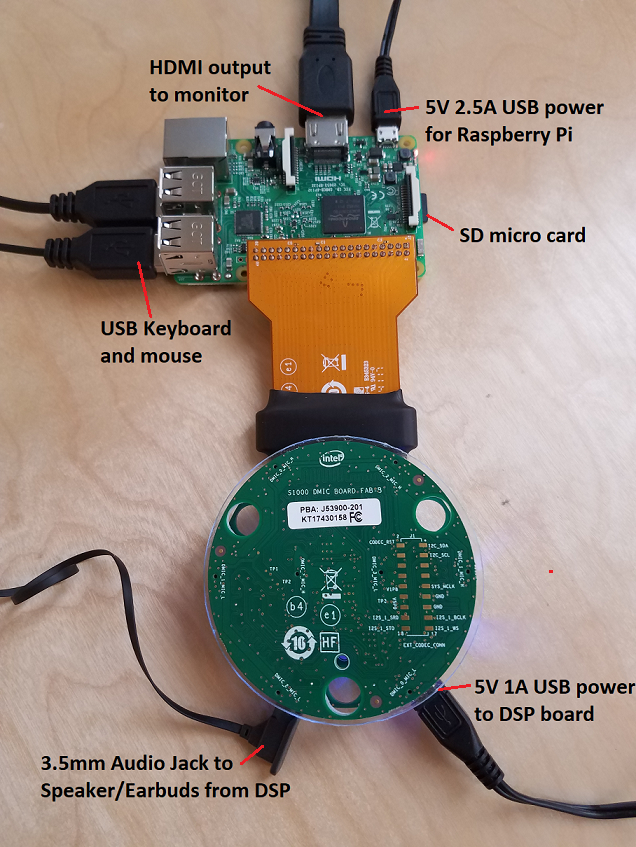

![]()

下記のようにDSPボードの3.5mmオーディオコネクターにスピーカーもしくはイヤフォンを差し込んでください。Raspberry Piのオーディオジャックは使用しないよう注意してください。次に電源をDSPボードのUSBマイクロコネクターに接続します。DSPボードの下部に青いLEDがつくことで電源が入ったことが確認できます。スピカーの電源が入っていることも確認してください - 万が一つかない場合はバッテリーの充電を行ってください。 USBマイクロケーブルをスピーカーのコネクターに差し込むことで、バッテリーの充電が行なえます。

下記の写真を確認し、キットのすべての接続が正しく行われていることを確認してください。ラズパイの電源を入れた際に、Intelキットのマイクアレイボードの円形白LEDが点灯します。この写真ではイーサネット接続がされていません。

ラズパイの起動

- ラズパイのマイクロUSBコネクターに電源を差します。

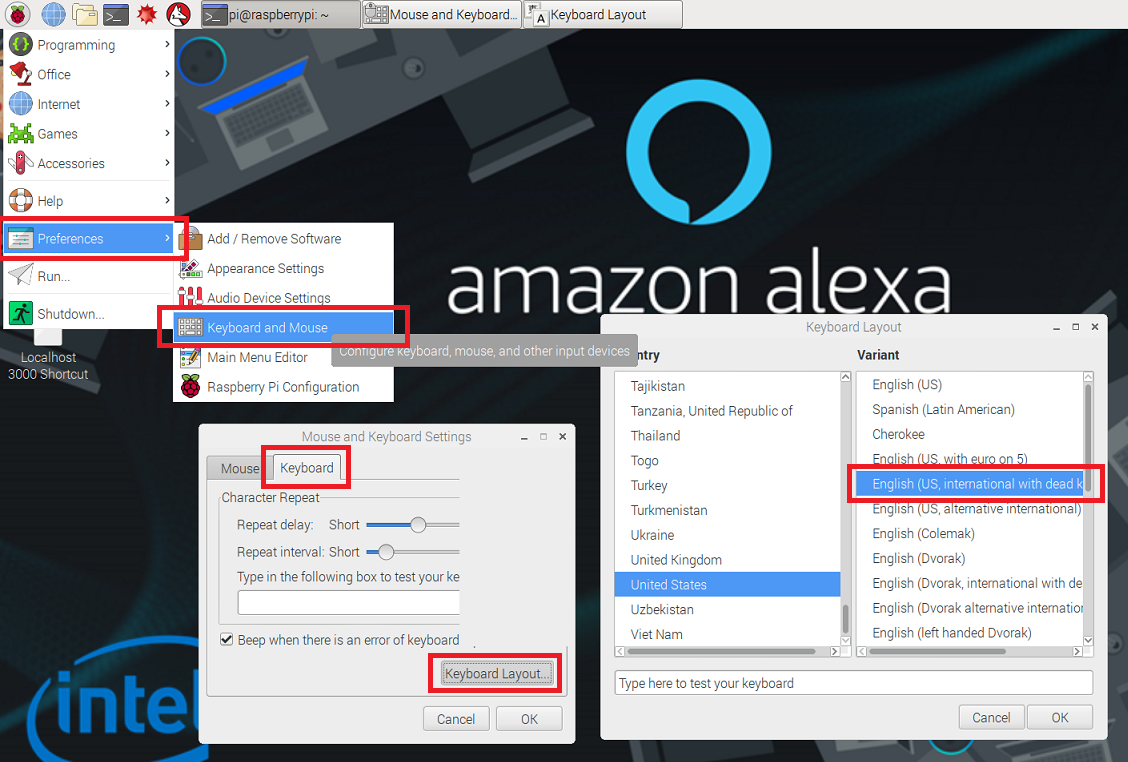

- キーボードレイアウトが正しいことを確認してください。(日本語キーボードの場合は、Japaneseを選択) 画面左上部のRaspberryアイコンからKeyboard and Mouse設定を選択して変更してください。

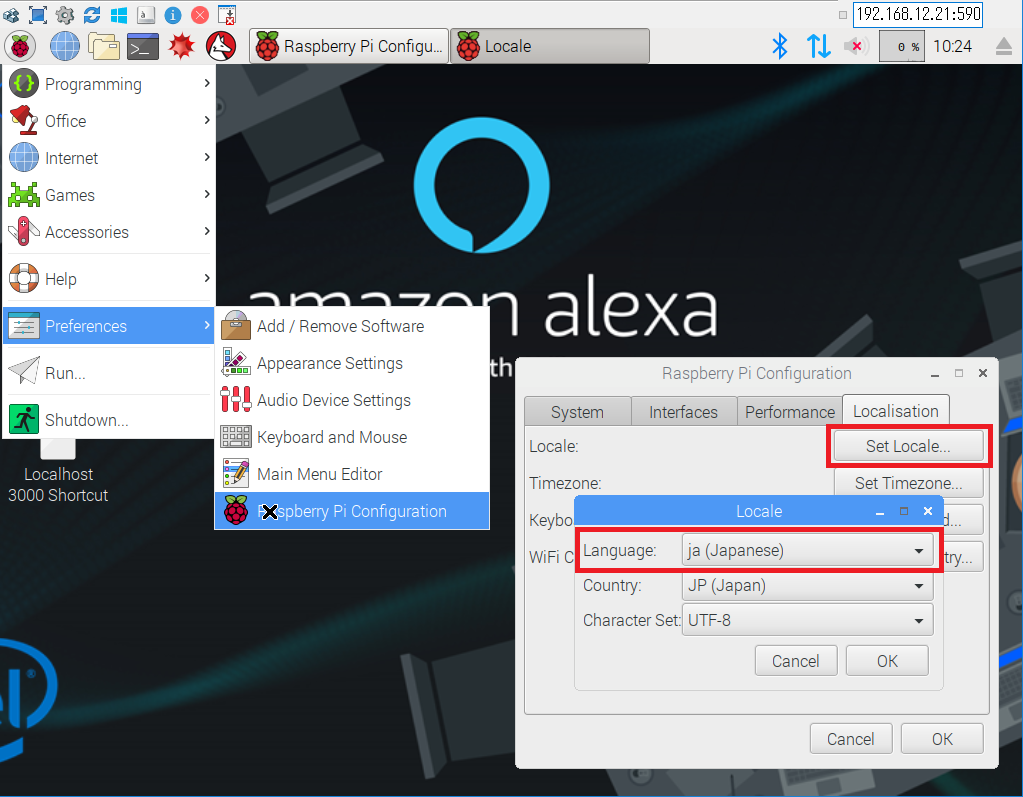

- OS言語が正しいことを確認してください。(日本語のAlexaを利用する場合は、Japaneseを選択) 画面左上部のRaspberryアイコンから、Raspberry Pi Configurationを選択しLocaleをja(Japan)に設定してください。

- OSの再起動が促されるため、再起動を行い画面が日本語に変更されていることを確認してください。

- ツールバー上の地球のアイコンをクリックし、ブラウザーを起動してください。

チェックポイント 1

- インターネットに接続されていることを確認し、https://developer.amazon.comにアクセスできる。

- Intelキット下部の青いLEDとマイクロフォンアレイの白いLEDが点灯している。